Згадзай О.Э. Информатика для юристов: Под ред. С.Я. Казанцева

Подождите немного. Документ загружается.

В теории информации принят энтропийный подход, который уста-

навливает ценность информации, содержащейся в сообщении для

его получателя, и исходит из следующей модели. Получатель сооб-

щения имеет представление о возможности наступления некото-

рых событий. Это представление в общем случае недостоверно и

выражается вероятностями, с которыми он ожидает то или иное

событие. Общая мера неопределенности (энтропия) характеризу-

ется формулой S -\nW, где W

—

число всевозможных комбина-

ций, которыми может быть выражено некоторое состояние.

Количество информации в сообщении определяется

тем,

насколько

уменьшается эта мера после получения сообщения. Тривиальное со-

общение не несет информации. Сообщение несет полную информа-

цию о некотором событии, если оно снимает всю неопределенность.

Пример. Бросание монеты. До падения монеты вероятность

выпадения одной из сторон 0,5 и возможны две комбинации. Пос-

ле падения реализована единственная комбинация.

Пример. Одним из жителей города, деликтоспособное населе-

ние которого составляет примерно

1

млн, совершено преступление.

Неопределенность относительно лица, совершившего это пре-

ступление определяется энтропией S

0

= log

2

1000000 = 20 бит.

Получено сообщение, что преступник — мужчина. Информа-

ция, содержащаяся в этом сообщении, — /,

=

log

2

2 = 1 бит.

В результате энтропия стала £, = S

0

—

/,

=

19 бит.

Получено сообщение о возрасте преступника (при деликтоспо-

собном интервале возраста 78

—

14 = 64 года). Информация, со-

держащаяся в этом сообщении, — I

2

= log

2

64 = 6 бит.

В результате энтропия стала S

2

= £,— 1

2

~ 13 бит.

Получено сообщение о дате рождения преступника. Информа-

ция, содержащаяся в этом сообщении, — /

3

= log

2

365 = 8,5 бит.

В результате энтропия стала 5

3

= S

2

~ /,= 4,5 бит.

Могут прийти сообщения о районе проживания, образовании

преступника и т.п., которые также уменьшат энтропию (неопре-

деленность).

В технике часто используют более простой и грубый объемный

способ измерения информации (данных). Он основан на подсчете

числа символов в сообщении, т.е. связан с его длиной и не учиты-

вает содержания. В вычислительной технике применяют две стан-

дартные единицы измерения: бит и байт.

Бит

—

это один символ двоичного алфавита. Он позволяет пол-

ностью передать информацию о реализации события, которое

может иметь два исхода. Например, бросание монеты.

Байт — это количество информации, которое можно передать

с помощью 8 двоичных символов, восьмиразрядного двоичного

кода. Он позволяет полностью передать информацию о реализации

события, которое может иметь 2

8

= 256 исходов. Например, нажа-

тие на одну из клавиш компьютера.

И

Производные единицы измерения информации: килобайт —

1024 байт, мегабайт

—

1024 Кбайт, гигабайт

—

1024 Мбайт.

Шеннон —

единица измерения количества информации, равная

количеству информации, содержащейся в сообщении, выражен-

ном одним из двух равновероятных, взаимоисключающих и ис-

черпывающих состояний.

Дит — единица количества информации, содержащейся в со-

общении о данном состоянии системы, имеющей 10 равновероят-

ных состояний.

Два рассмотренных способа измерения информации, как пра-

вило,

не совпадают. Энтропийное количество информации никог-

да не превосходит объемного.

При измерении информации, циркулирующей в ЭВМ, исполь-

зуют в основном объемный подход.

Информационные процессы. Информация может не только быть

воспринята познающим субъектом или техническим устройством,

но и отделена от своего первоисточника. В результате информация

может быть подвергнута операциям, совокупность которых назы-

вают информационными процессами.

Информационные

процессы — это процессы восприятия, нако-

пления, обработки и передачи информации.

Объект-оригинал

lllv

Сигнал-носитель

информации

Потребитель информации

Декодирование сигнала

Ш

Передатчик

сигнала

Приемник

сигнала

Рис.

1.1. Сигнал в информационном процессе

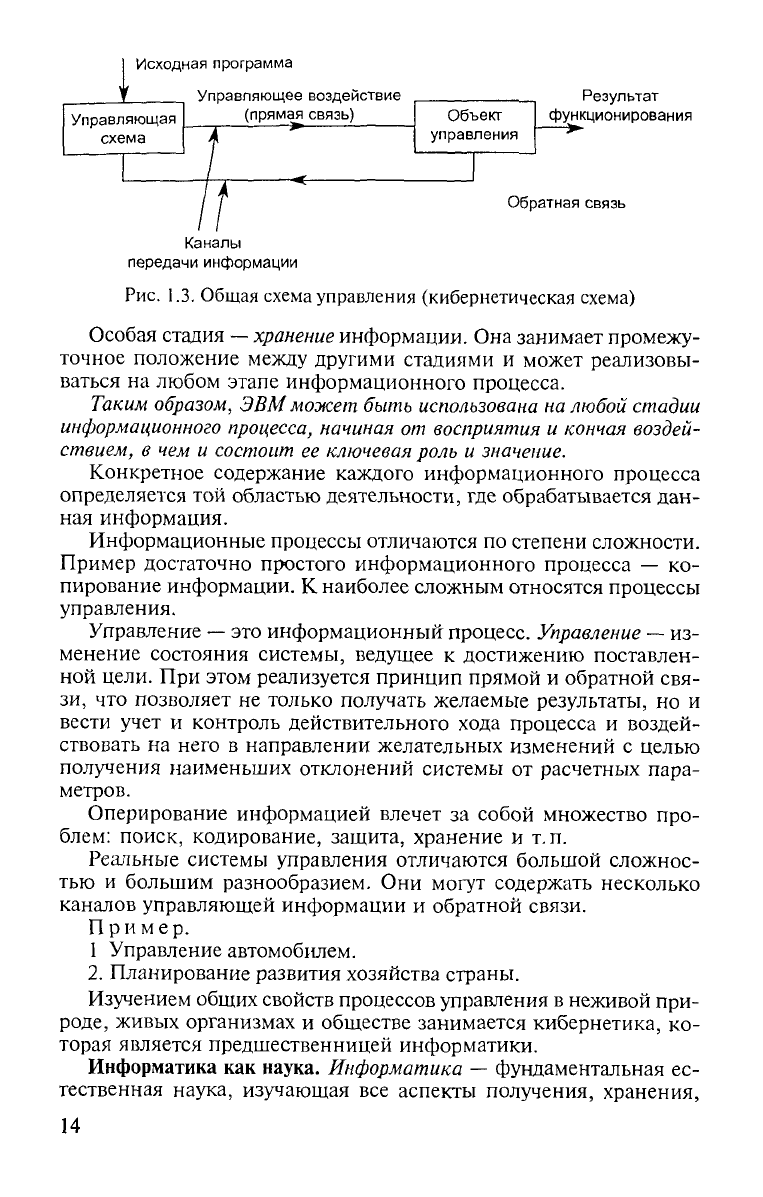

Проявляется информация всегда в материально-энергетической

форме, в частности, в виде сигналов. Сигнал может иметь самую

различную физическую природу, и в информационном процессе

он выполняет функцию переносчика информации от источника к

приемнику и далее к адресату. Этот процесс показан на рис. 1.1 в

виде блок-схемы.

Процесс

передачи

информации

—

многоступенчатый процесс, сиг-

нал может на каждом из промежуточных этапов менять свою физи-

ческую природу. При этом возникают вопросы о взаимной однозначно-

сти (изоморфности) информации, ее сигнала, полноте и объектив-

ности передачи, возможности восприятия принимающим субъектом.

Передача информации

—

это лишь одна фаза информационно-

го процесса. Общая структура информационного процесса пред-

ставлена на рис. 1.2.

12

Передача

информации

Восприятие

информации

Зарождение

информации

Взаимодействую-

щие объекты

Хранение

информации

Обработка

информации

Представление

информации

Воздействие

информации

Потребитель

информации

Рис 1.2. Структура информационного процесса

Собственно информационный процесс начинается с восприя-

тия и фиксации информации, содержащейся в том или ином ис-

точнике. Информация отделяется от шумов. Процесс завершается

формированием сигнала, с помощью которого информация пере-

дается. Сигнал

обладает определенной

структурой,

которую

можно

выразить в дискретной

форме.

На принципах передачи сигналов,

подвергшихся дискретизации, основана работа ЭВМ, которые

способны выполнять формально-логические операции. Машина обу-

чена воспринимать введенный в нее класс объектов, признаки

которых закодированы. Существенная разница между ЭВМ и чело-

веком заключается в том, что человек субъективно воспринимает

образ объекта, а ЭВМ — коды различных признаков объекта.

Независимо от принципиального различия в восприятии инфор-

мации человеком и ЭВМ информационный процесс начинается с

восприятия и выделения информации. Сама информация

—

это со-

держание сигнала, который удобен для передачи по физическим

каналам связи: электрическим, акустическим, оптическим и т.д.

Прием информации

—

вторичное ее восприятие другим субъек-

том или принимающим устройством.

Обработка

информации осуществляется человеком или техни-

ческим устройством, в частности ЭВМ. Сущность обработки ин-

формации компьютером — аналоговое или цифровое преобразо-

вание поступающих данных по жесткой программе или алгоритму

обработки. Для успешной обработки информации и решения зада-

чи ЭВМ должна иметь небольшой набор переменных. Человек, в

отличие от компьютера, способен проводить смысловую и логи-

ческую обработку информации.

Завершается информационный процесс

представлением

инфор-

мации потребителю,

т.

е.

демонстрацией на индикаторах различно-

го вида изображений и принятием решения.

13

Результат

функционирования

связь

Рис.

1.3. Общая схема управления (кибернетическая схема)

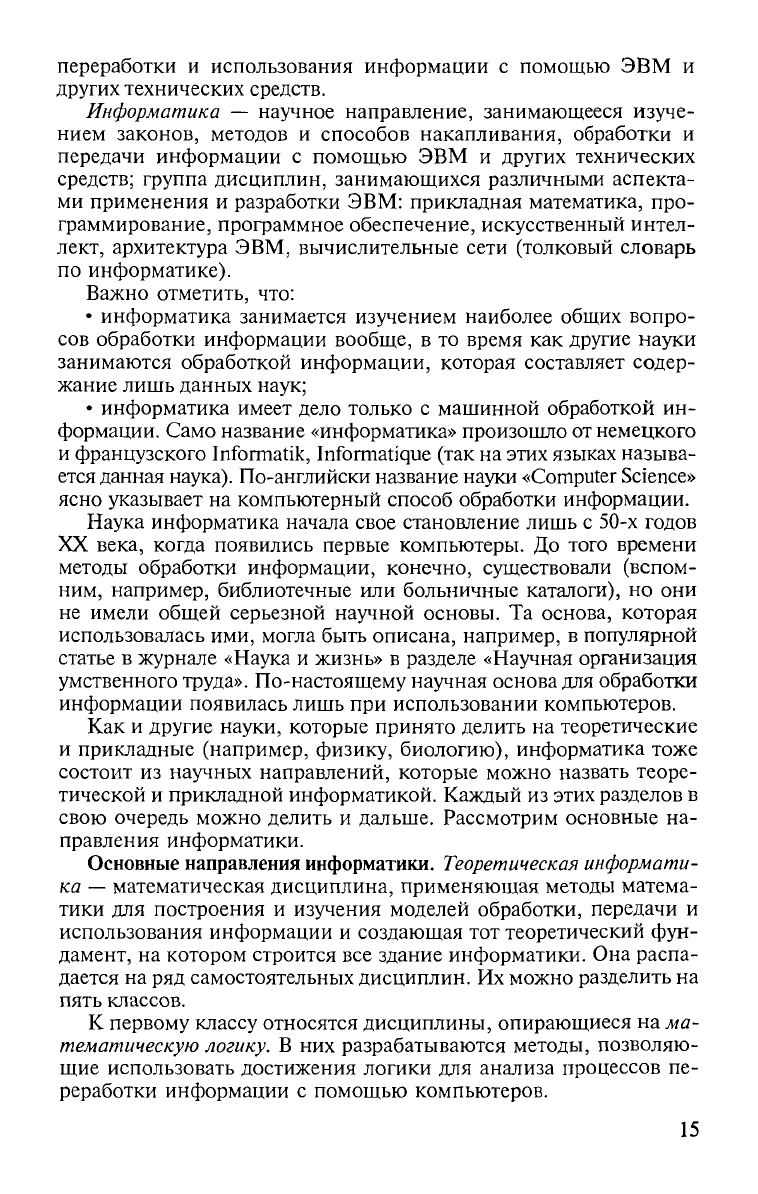

Особая стадия

— хранение

информации. Она занимает промежу-

точное положение между другими стадиями и может реализовы-

ваться на любом этапе информационного процесса.

Таким

образом,

ЭВМ

может быть использована

на любой стадии

информационного

процесса,

начиная от восприятия и кончая воздей-

ствием, в чем и

состоит

ее ключевая роль и значение.

Конкретное содержание каждого информационного процесса

определяется той областью деятельности, где обрабатывается дан-

ная информация.

Информационные процессы отличаются по степени сложности.

Пример достаточно простого информационного процесса — ко-

пирование информации. К наиболее сложным относятся процессы

управления.

Управление

—

это информационный процесс.

Управление —

из-

менение состояния системы, ведущее к достижению поставлен-

ной цели. При этом реализуется принцип прямой и обратной свя-

зи,

что позволяет не только получать желаемые результаты, но и

вести учет и контроль действительного хода процесса и воздей-

ствовать на него в направлении желательных изменений с целью

получения наименьших отклонений системы от расчетных пара-

метров.

Оперирование информацией влечет за собой множество про-

блем: поиск, кодирование, защита, хранение и т.п.

Реальные системы управления отличаются большой сложнос-

тью и большим разнообразием. Они могут содержать несколько

каналов управляющей информации и обратной связи.

Пример.

1 Управление автомобилем.

2.

Планирование развития хозяйства страны.

Изучением общих свойств процессов управления в неживой при-

роде, живых организмах и обществе занимается кибернетика, ко-

торая является предшественницей информатики.

Информатика как наука. Информатика — фундаментальная ес-

тественная наука, изучающая все аспекты получения, хранения,

Исходная программа

Управляющая

схема

Управляющее воздействие

(прямая связь)

Объект

управления

Обр

Каналы

передачи информации

14

переработки и использования информации с помощью ЭВМ и

других технических средств.

Информатика — научное направление, занимающееся изуче-

нием законов, методов и способов накапливания, обработки и

передачи информации с помощью ЭВМ и других технических

средств; группа дисциплин, занимающихся различными аспекта-

ми применения и разработки ЭВМ: прикладная математика, про-

граммирование, программное обеспечение, искусственный интел-

лект, архитектура ЭВМ, вычислительные сети (толковый словарь

по информатике).

Важно отметить, что:

• информатика занимается изучением наиболее общих вопро-

сов обработки информации вообще, в то время как другие науки

занимаются обработкой информации, которая составляет содер-

жание лишь данных наук;

• информатика имеет дело только с машинной обработкой ин-

формации. Само название «информатика» произошло от немецкого

и французского Informatik, Informatique (так на этих языках называ-

ется данная наука). По-английски название науки «Computer Science»

ясно указывает на компьютерный способ обработки информации.

Наука информатика начала свое становление лишь с 50-х годов

XX века, когда появились первые компьютеры. До того времени

методы обработки информации, конечно, существовали (вспом-

ним, например, библиотечные или больничные каталоги), но они

не имели общей серьезной научной основы. Та основа, которая

использовалась ими, могла быть описана, например, в популярной

статье в журнале «Наука и жизнь» в разделе «Научная организация

умственного труда». По-настоящему научная основа для обработки

информации появилась лишь при использовании компьютеров.

Как и другие науки, которые принято делить на теоретические

и прикладные (например, физику, биологию), информатика тоже

состоит из научных направлений, которые можно назвать теоре-

тической и прикладной информатикой. Каждый из этих разделов в

свою очередь можно делить и дальше. Рассмотрим основные на-

правления информатики.

Основные направления информатики.

Теоретическая

информати-

ка — математическая дисциплина, применяющая методы матема-

тики для построения и изучения моделей обработки, передачи и

использования информации и создающая тот теоретический фун-

дамент, на котором строится все здание информатики. Она распа-

дается на ряд самостоятельных дисциплин. Их можно разделить на

пять классов.

К первому классу относятся дисциплины, опирающиеся на ма-

тематическую логику. В них разрабатываются методы, позволяю-

щие использовать достижения логики для анализа процессов пе-

реработки информации с помощью компьютеров.

15

Ко второму классу относятся дисциплины, лежащие на грани-

це между дискретной математикой и теоретической информати-

кой

(вычислительная математика

и

вычислительная

геометрия).

Эти

науки направлены на создание методов, ориентированных на реа-

лизацию на компьютерах.

Теория информации и теория кодирования занимаются выявле-

нием общих свойств информации и изучением тех форм, в кото-

рых содержатся конкретные информационные единицы. Специ-

альный раздел посвящен теоретическим вопросам передачи ин-

формации по каналам связи.

Системный анализ —

изучает структуру реальных объектов и дает

способы их формализованного описания. Системный анализ зани-

мает пограничное положение между теоретической информати-

кой и кибернетикой. Такое же положение занимают имитационное

моделирование

(воспроизведение процессов, протекающих в реаль-

ных объектах в тех моделях объектов, которые реализуются на ЭВМ)

и

системы массового

обслуживания.

Теория

принятия

решений,

теория игр

—

дисциплины, ориенти-

рованные на использование информации для принятия решений в

самых различных ситуациях. При организации поведения, ведуще-

го к нужной цели, принимать решения приходится многократно.

Поэтому выбор отдельных решений должен подчиняться общему

плану. Этим занимается

исследование

операций.

Кибернетика

— наука об управлении в живых, неживых и искус-

ственных системах. Кибернетика может рассматриваться как при-

кладная информатика в области создания и использования автома-

тических или автоматизированных систем управления разной сте-

пени сложности, от управления отдельным объектом (станком, про-

мышленной установкой, автомобилем и

т.

п.) до сложнейших сис-

тем управления целыми отраслями промышленности, банковски-

ми системами, системами связи и даже сообществами людей. Наи-

более активно развивается техническая кибернетика, результаты

которой используются для управления в промышленности и науке.

Программирование

полностью связано с вычислительными ма-

шинами и включает создание отдельных программ и пакетов при-

кладных программ, разработка языков программирования, созда-

ние операционных систем, организация взаимодействия компью-

теров с помощью протоколов связи.

Искусственный интеллект

имеет целью проникнуть в тайны твор-

ческой деятельности людей, их способности к овладению навыка-

ми,

знаниями и умениями. Для этого необходимо раскрыть те глу-

бинные механизмы, с помощью которых человек способен на-

учиться практически любому виду деятельности. Если суть этих ме-

ханизмов будет разгадана, то удастся реализовать их подобие в ис-

кусственных системах. ИИ — наука не чисто теоретическая. Она

занимается и прикладными вопросами. Например, робототехни-

16

кой (создание роботов), созданием баз знаний и экспертных сис-

тем на основе этих баз знаний. Некоторые из экспертных систем

находят применение в ОВД («Маньяк», Блок раскрытия хищений

на строительстве и т.п.).

Информационные системы —

системы, предназначенные для хра-

нения, поиска, обработки и выдачи информации по запросам

пользователей.

Современное состояние развития информационной технологии

в США, странах Западной Европы и Японии характеризуется, в

частности, следующими тенденциями:

• наличием значительного количества банков данных большого

объема, содержащих информацию практически по всем видам де-

ятельности общества;

• созданием локальных многофункциональных проблемно-ори-

ентированных информационных систем различного назначения.

В России наблюдаются аналогичные тенденции. Созданы банки

данных, содержащие научную, технологическую и другую инфор-

мацию, в т.ч. правовую (системы «Кодекс», «Гарант», «Консуль-

тант» и др.). В ОВД информация хранится в виде различных учетов

(дактилоскопический, пофамильный, пулегильзотеки, учет похи-

щенных и обнаруженных вещей и др.). Часть из них переведена в

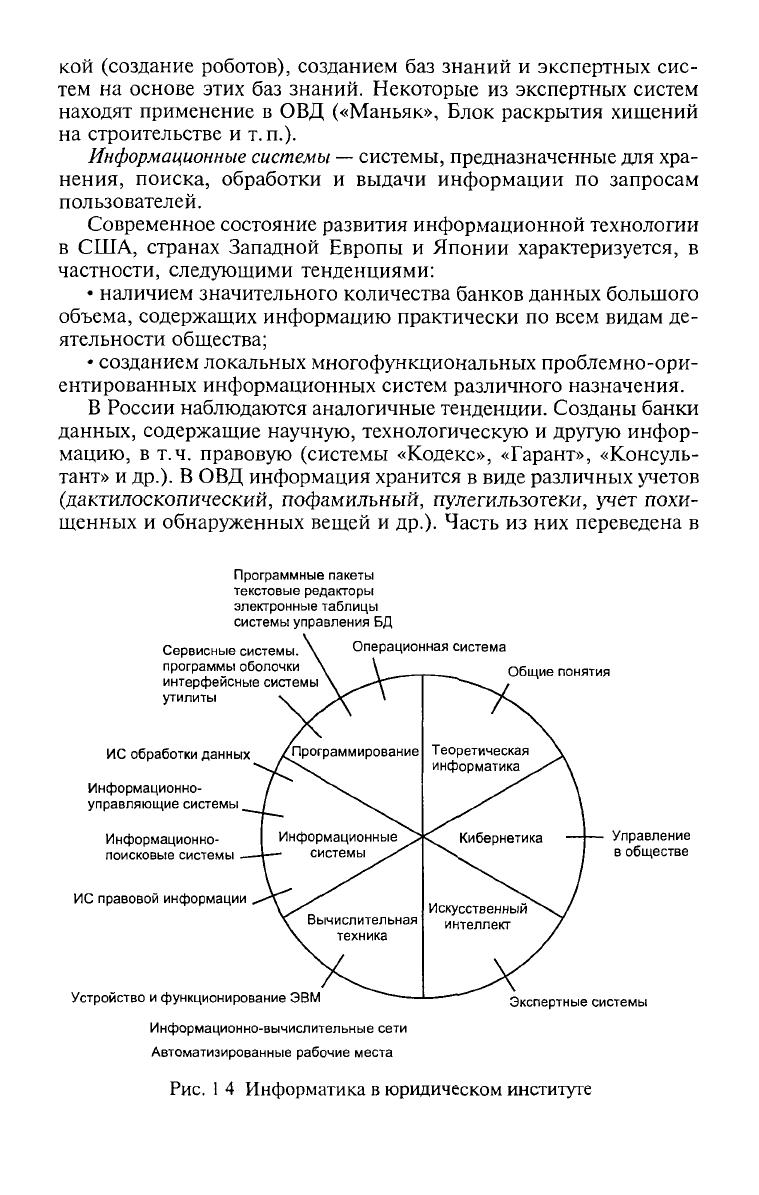

Программные пакеты

текстовые редакторы

электронные таблицы

системы управления БД

Сервисные системы,

программы оболочки

интерфейсные системы

утилиты

Операционная система

Общие понятия

ИС обработки данных

Информационно-

управляющие системы

Информационно-

поисковые системы

ИС правовой информации

Устройство и функционирование ЭВМ

Информационно-вычислительные сети

Автоматизированные рабочие места

Управление

в обществе

Экспертные системы

Рис.

1

4 Информатика в юридическом институте

электронную форму, однако это лишь относительно небольшая

часть. Задача перевода всех учетов в электронную форму и органи-

зации доступа к ним через вычислительную сеть является одной из

наиболее актуальных.

Для организации доступа к централизованно или распределен-

ие хранящейся информации создаются информационно-вычисли-

тельные сети разного уровня. Для этого необходима разработка спе-

цифического оборудования, программного обеспечения, развитие

средств связи и коммуникаций (последнее особенно актуально для

России с ее большими расстояниями и традиционно плохим каче-

ством линий связи).

Вычислительная техника — это самостоятельное направление,

в котором часть задач не имеет прямого отношения к информати-

ке (микроэлектроника). Однако при разработке, проектировании

и производстве ЭВМ очень широко используются достижения ин-

форматики.

1.2. ПЕРСОНАЛЬНЫЙ КОМПЬЮТЕР

В настоящее время основная работа по информационному об-

служиванию управления ведется на персональных ЭВМ, называе-

мых также персональными компьютерами (ПК), программно и ап-

паратно совместимыми с ПК фирмы IBM. Такие ПК обычно на-

зывают IBM PC совместимыми. При работе с ними используется

английская терминология, поэтому представляется целесообраз-

ным дать ее перевод на русский язык;

IBM (International Business Machines Corporation) — междуна-

родная корпорация машин для бизнеса;

PC (Personal Computer) — персональный компьютер.

Первые модели IBM PC появились в августе 1981 г. Сейчас эти

ПК наиболее распространены во всем мире. В правоохранительных

органах IBM PC совместимыми компьютерами оснащаются все

структуры, начиная от центральных аппаратов и кончая отделами

на местах. На их базе создаются автоматизированные рабочие мес-

та сотрудников.

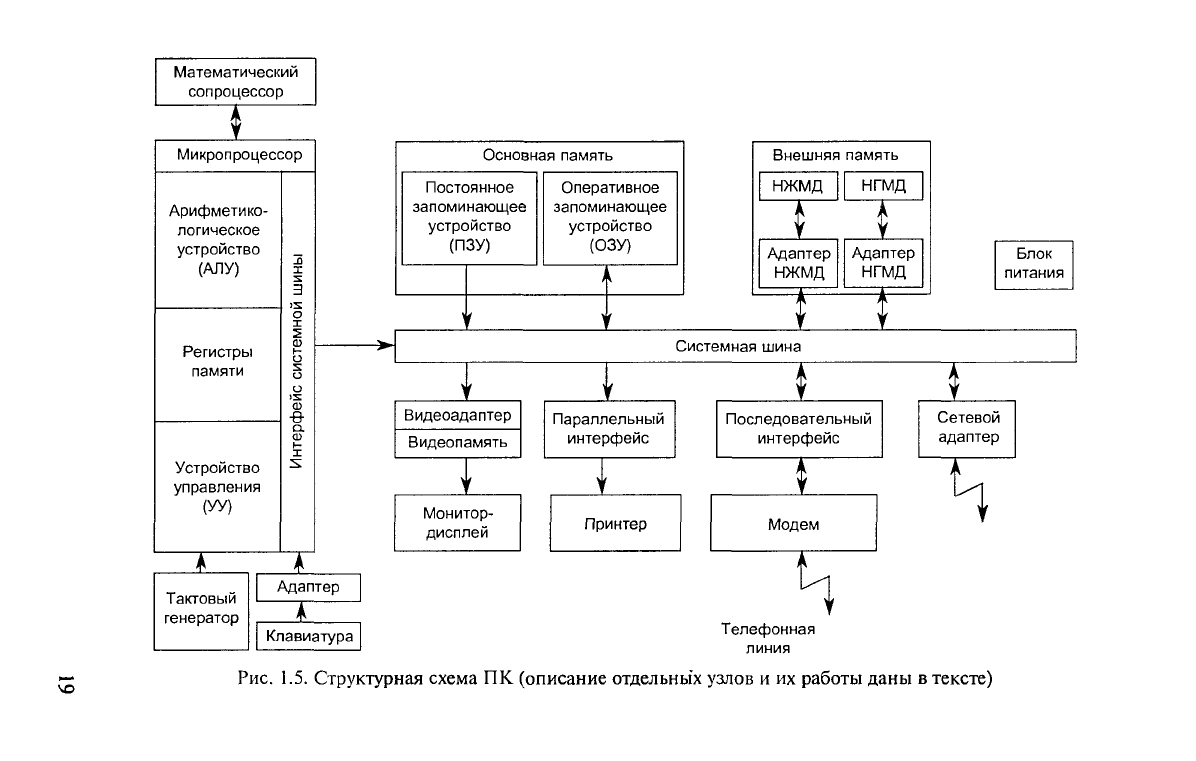

IBM PC, как и все ЭВМ, включает в себя два основных компо-

нента: оборудование, или аппаратную часть, называемую hardware,

и программы, или программное обеспечение, называемое

software.

К программному обеспечению относятся операционные системы,

трансляторы с алгоритмических языков (BASIC, PASCAL, С и т.д.),

различные прикладные программные системы. Основной опера-

ционной системой, используемой в IBM PC совместимых ПК, до

последнего времени являлась MS DOS (Microsoft Disk Operating

System)

—

дисковая операционная система фирмы Microsoft.

В последнее время все более широкое распространение получа-

ет операционная система Windows 95/98.

18

Математический

сопроцессор

л

Микропроцессор

Арифметико-

логическое

устройство

(АЛУ)

Регистры

памяти

Устройство

управления

(УУ)

А

А

Тактовый

генератор

Адаптер

А

Клавиатура

Основная память

Постоянное

запоминающее

устройство

(ПЗУ)

Оперативное

запоминающее

устройство

(ОЗУ)

А

Внешняя память

НЖМД

НГМД

Л

Адаптер

НЖМД

1

Адаптер

НГМД

А

'

v

w i \

5

Блок

питания

'

Системная шина

V

Видеоадаптер

Видеопамять

>'

Монитор-

дисплей

1

f

Параллельный

интерфейс

>

Принтер

к

А

V

V

Последовательный

интерфейс

А

Модем

А

У

Сетевой

адаптер

^

Л

Телефонная

линия

Рис.

1.5.

Структурная схема

ПК

(описание отдельных узлов

и их

работы даны

в

тексте)

Операционная система обеспечивает решение двух главных

задач:

• предоставление пользователям возможности общего управле-

ния компьютером;

• поддержка работы всех программ, обеспечение их взаимодей-

ствия с аппаратурой.

К аппаратной части относятся следующие устройства:

CPU (Central Proceccing Unit) — центральное процессорное

устройство (ЦПУ), выполненное на основе микропроцессора фир-

мы Intel Corporation, называемое также Central processor

—

Цент-

ральный процессор (ЦП);

ALU (Arithmetic Logical Unit)

—

арифметико-логическое устрой-

ство (АЛУ);

CU (Control Unit) — устройство управления (УУ);

Controller — контроллер (УУ подсистемами ПК);

ROM — (Read Only Memory) — постоянное запоминающее

устройство (ПЗУ);

Monitor

—

монитор (дисплей, экран), Printer —принтер (печа-

тающее устройство), Keyboard — клавиатура

—

устройство ввода-

вывода;

MSD (Mass Storage Device) — устройство массового хранения

(память на накопителях, внешнее запоминающее устройство);

Disk drive

—

дисковод (устройство для считывания и записи ин-

формации на магнитные диски);

Hard disk drive, Winchester disk — накопитель на жестком маг-

нитном диске (НМД), винчестерский диск (винчестер);

Floppy disk drive — накопитель на гибком магнитном диске

(НГМД) (на дискете, гибком диске).

Большинство из перечисленных компонентов IBM PC объеди-

нены в

системный

блок (system unit).

Основным устройством IBM PC является центральное процес-

сорное устройство (CPU), состоящее из арифметико-логического

устройства (ALU) и устройства управления (CU).

ALU осуществляет с данными операции сложения, вычитания,

умножения, деления, сравнения и т.д.

CU устанавливает очередность выполнения операций, управ-

ляет потоками данных внутри и между блоками IBM PC.

Память IBM PC состоит из ОЗУ (RAM) и ПЗУ (ROM), а так-

же памяти на накопителях (MSD).

ПЗУ реализована на микросхемах, информация с которых мо-

жет только считываться, не изменяясь при этом. Она содержит BIOS

(basic input/output system) — базовую систему ввода/вывода, явля-

ющуюся первой основной компонентой операционной системы

MS DOS. BIOS MS-DOS выполняет следующие функции:

• устанавливает, какие устройства подключены к IBM PC,

т.

е.

выясняет конфигурацию системы;

20